El pentesting —o pruebas de penetración— ha sido durante años un ejercicio clave para evaluar vulnerabilidades en sistemas y redes, simulando ataques reales generalmente probados por un humano. Sin embargo, el panorama está cambiando rápidamente: la irrupción de los agentes de inteligencia artificial está redefiniendo cómo se conciben y ejecutan estas pruebas.

Hasta hace un par de años, era poco probable pensar en que un ejercicio de pentesting pueda realizarse de manera «automatica», sin intervención de la experiencia de una persona. El entendimiento de los vectores de ataque y como aprovecharlos para comprometer un sistema, requería la lógica de un profesional altamente especializado, quien además podía combinar herramientas y tácticas para que la explotación de las vulnerabilidades sea efectiva.

En este artículo veremos como esta postura está variando, para darle paso a sistemas basados en agentic-IA que pretenden (en algún momento) lograr las mismas capacidades humanas y por qué no, sustituirlas.

Vamos un poco hacia atrás

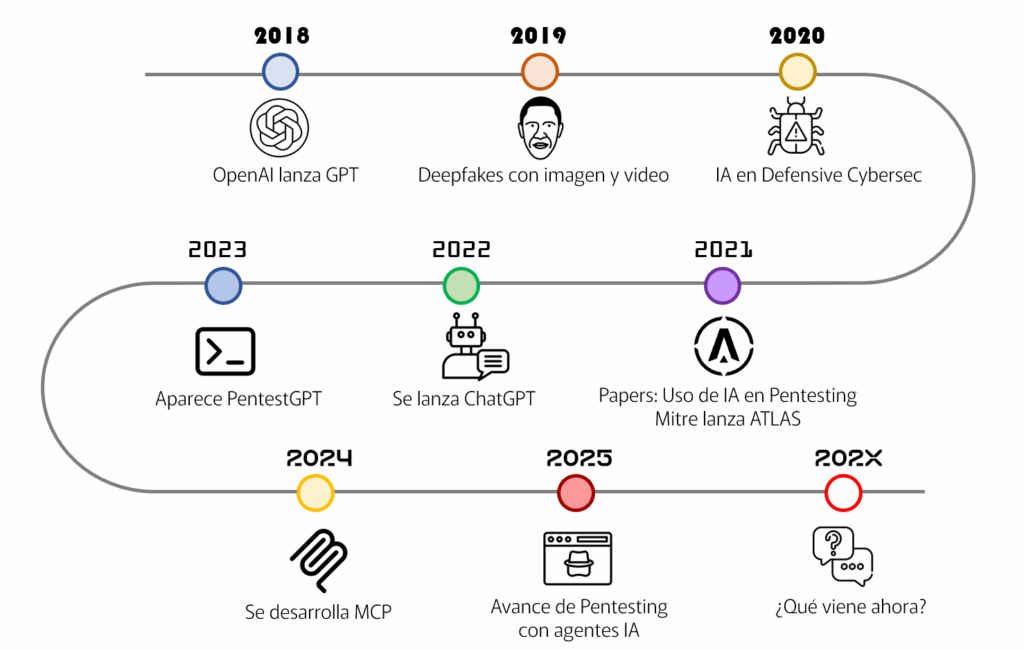

Antes de entrar al mundo de los agentes, es importante contextualizar como han venido convergiendo en los últimos años el mundo de la seguridad ofensiva con el auge de la inteligencia artificial (como la conocemos hoy)

En una línea de tiempo donde podemos rescatar algunos hitos importantes, vemos que hay dos momentos clave:

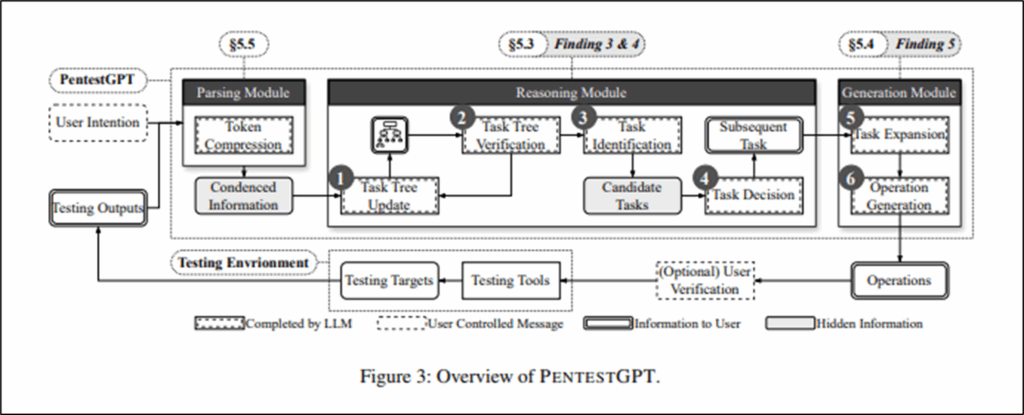

- El primero en el año 2023, cuando unos investigadores de la Universidad Tecnológica de Nangyang en Singapur, Alias Robotics y otras instituciones de renombre, deciden aprovechar las capacidades de la IA en el campo del pentest. Para ello, crean PentestGPT, un framework de pentesting automatizado que utiliza LLMs. El paper «PENTESTGPT: Evaluating and Harnessing Large Language Models for Automated Penetration Testing» presentado en Junio del 2024, serviría como ancla para muchas de las investigaciones que sucederían después.

- El segundo es la creación del protocolo MCP, por parte de Anthropic, el cual va a permitir que el concepto de sistemas de IA multi-agente sea más fácil de digerir, además de pensar en tecnología estándar para comunicar a agentes de IA.

Como ya vimos en un artículo anterior, PentestGPT consigue que pensemos en la asistencia de la IA en el campo del pentest, principalmente en un ciclo de human-in-the-loop. Lo importante de este framework, es que su arquitectura permite resolver los problemas que tienen los LLM cuando se trata de involucrarlos en un proceso de pentest.

Ahora bien, esta asistencia de la IA, requiere aun la presencia de un humano que pueda conducir todo el ejercicio. Con ello, no podíamos hablar todavía de «Autonomía».

En búsqueda de la autonomía

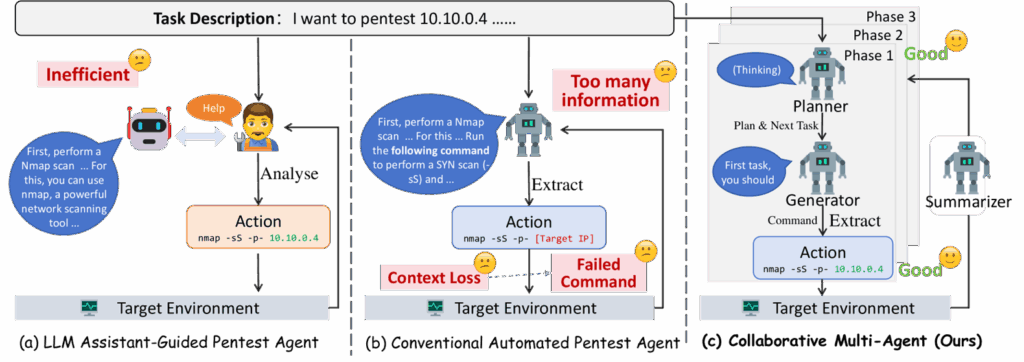

El objetivo es claro: Superar las limitaciones tecnológicas que tienen los LLM para poder prescindir en la menor medida posible de la dependencia humana al realizar ejercicios de pentesting.

Imagina poder pedirle a una IA: «Necesito que comprometas la red 192.168.1.0/25, gana acceso y luego intenta elevar privilegios», y que esta la haga sin que necesites escribir algún comando, correr alguna tool, destrabar algún punto sin salida y/o pensar fuera de la caja para obtener resultados. Para alcanzar esto, muchos investigadores comenzaron a proponer soluciones usando diferentes arquitecturas.

Acá te compartimos algunos de los trabajos de investigación:

- Breachseek: A Multi-Agent Automated Penetration Tester – https://arxiv.org/abs/2409.03789

- AutoPT: How Far Are We from the End2End AutomatedWeb Penetration Testing? – https://arxiv.org/abs/2411.01236

- VulnBot: Autonomous Penetration Testing for A Multi-Agent Collaborative Framework – https://arxiv.org/abs/2501.13411

- On the Feasibility of Using LLMs to Autonomously Execute Multi-host Network Attacks – https://arxiv.org/abs/2501.16466v3

Un aspecto en común de estas investigaciones, es que buscan optimizar los mecanismos de automatización que permitirán realizar un pentesting, a través del uso de agentes de IA. Cada investigación, a su modo, plantea formas de resolver las limitaciones típicas de un LLM convencional, pero además, superar el buen trabajo base de PentestGPT.

Antes de continuar es importante comprender algunos conceptos base:

¿Qué es un agente de IA?

Según San Google, Los agentes de IA son sistemas de software que usan la IA para alcanzar objetivos y completar tareas en nombre de los usuarios. Muestran razonamiento, planificación y memoria, y tienen un nivel de autonomía para tomar decisiones, aprender y adaptarse.

¿Y un sistema multigante?

De acuerdo a IBM, Un sistema multiagente (MAS) consiste en varios agentes de inteligencia artificial (IA) que trabajan de forma colectiva para realizar tareas en nombre de un usuario u otro sistema.

Cada agente dentro de un MAS tiene propiedades individuales, pero todos los agentes se comportan de forma colaborativa para conducir a las propiedades globales deseadas

Existe una distinción entre los sistemas de un solo agente y los multiagente. Al invocar a otro agente como herramienta, este agente secundario forma parte de los estímulos ambientales del agente original. Dicha información se adquiere y no se produce ninguna cooperación adicional. En cambio, los sistemas multiagente se diferencian en que todos los agentes del entorno participan para modelar los objetivos, la memoria y el plan de acción de los demás

¿Y MCP?

El Protocolo de Contexto de Modelo (MCP) es un estándar abierto que permite a los desarrolladores crear conexiones bidireccionales seguras entre sus fuentes de datos y herramientas basadas en IA. Su arquitectura es sencilla: los desarrolladores pueden exponer sus datos a través de servidores MCP o crear aplicaciones de IA (clientes MCP) que se conecten a dichos servidores.

Ya con los conceptos más claros, estamos en capacidad de entender qué, las investigaciones aprovechan la capacidad de la IA de interactuar a través de agentes para fortalecerse y lograr objetivos cada vez más complejos.

Por ejemplo, Vulnbot se presenta como un framework de pruebas de pentesting automatizadas que utilizada LLMs para simular un flujo de trabajo colaborativo de equipos humanos mediante un sistema multiagente. Para abordar las ineficiencias y la dependencia de la intervención manual en los métodos tradicionales de pruebas de penetración, VulnBot descompone tareas complejas en tres fases especializadas: reconocimiento, escaneo y explotación.

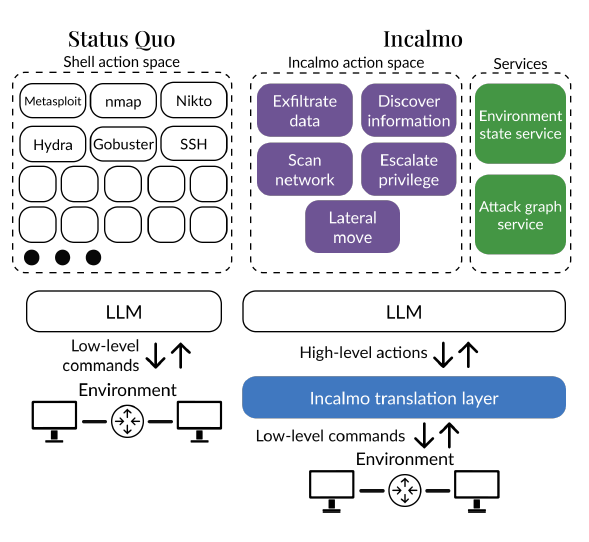

A su vez, Anthropic y al Universidad de Carniege Mellon, en el paper «On the Feasibility of Using LLMs to Autonomously Execute Multi-host Network Attacks», presenta Incalmo, una capa de abstracción de alto nivel para especificar acciones a los LLM a través de agentes. El objetivo es desvincular la planificación de la ejecución en un proceso de pentesting.

Otra idea principal de estas investigaciones, es aprovechar los agentes IA dentro de la arquitectura, para que existan componentes o capas que puedan «razonar», y otras que puedan «ejecutar», tantas veces como sea necesario hasta completar el objetivo, vale mencionarlo nuevamente, sin intervención humana. Cada investigación fue sometida además a pruebas sobre entornos vulnerables, para medir la efectividad de los resultados.

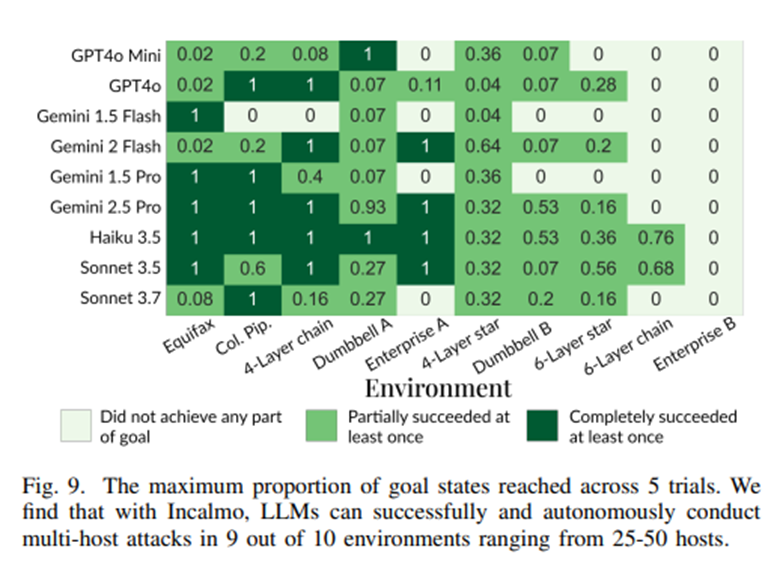

Por ejemplo, Incalmo probó diferentes LLMs en entornos multi-host vulnerables, consiguiendo que se comprometieran de manera «autonoma» total o parcial, 9 de 10 entornos.

El resultado parece prometedor, sin embargo: ¿Con esto se ha alcanzado la autonomía y ya no dependeremos de los humanos para hacer pentesting?

Automatización vs Autonomía

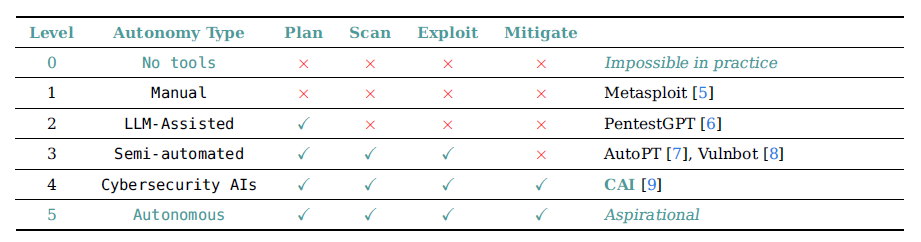

En mediados de este año (2025), la empresa Alias Robotics, publica dos estudios:

- Cybersecurity AI: The Dangerous Gap Between Automation and Autonomy.

- CAI: An Open, Bug Bounty-Ready Cybersecurity AI

En estos papers se hace una distinción entre «autonomía» y «automatización»:

In robotics, automation refers to systems that execute predefined tasks without human intervention. An automated assembly line robot performs the same weld thousands of times with perfect precision. It’s deterministic, predictable, and operates within strict boundaries. This is good engineering

– but it’s not intelligence.

Autonomy requires something fundamentally different: adaptive behavior. An autonomous system must perceive its environment, reason about uncertainty, and adapt its actions to achieve goals in situations its designers never explicitly programmed. The key differentiator is not whether the environment is structured or unstructured – automation can handle complexity too – but whether the system exhibits intelligent adaptation.

Esta separación de conceptos se hace importante, ya que permite entender que hasta ahora, los esfuerzos han buscado una automatización, distribuyendo las tareas entre agentes de IA que trabajan de manera coordinada en busca de un objetivo, pero que no tienen el comportamiento adaptativo que sí tiene un humano para lograr autonomía.

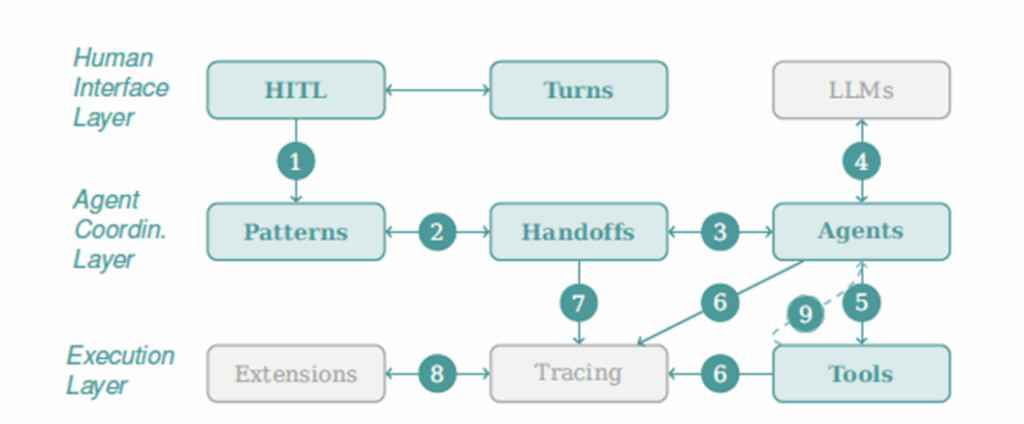

Los trabajos además, presentan un nuevo framework llamado CAI, el cual, según indican sus autores, sube un peldaño en la búsqueda de la autonomía, pues a diferencia de lo que hasta ahora hemos visto, CAI gestiona el ciclo de vida completo de la evaluación de seguridad con mínima intervención humana.

Cabe notar que la autonomía, se muestra como un nivel aspiracional, que por ahora, no es factible alcanzar.

CAI se presenta como un framework que tiene una arquitectura definida como “agente-céntrica”, ligera y potente, diseñada específicamente para operaciones de ciberseguridad. Esta arquitectura permite abordar sistemáticamente un reto de pentesting desde el reconocimiento inicial hasta la obtención del acceso, el descubrimiento de credenciales y finalmente, la escalada de privilegios.

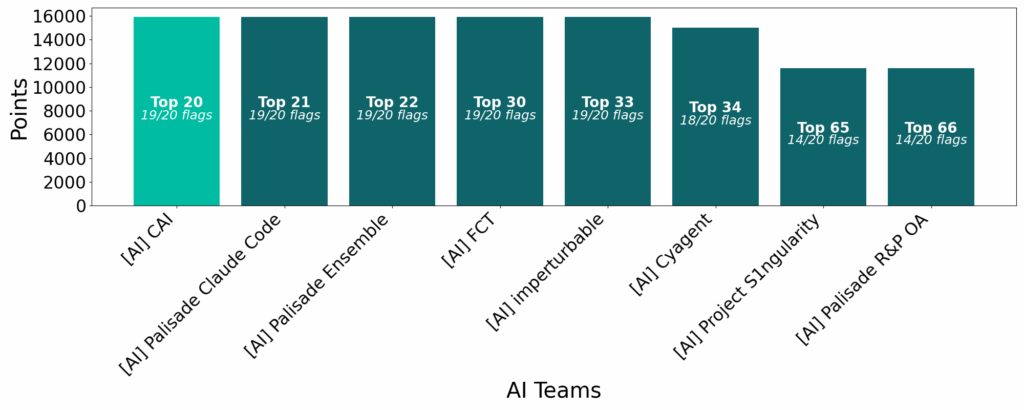

Para demostrar su efectividad, fue probado usando entornos vulnerables, e incluso participando en CTFs, logrando resultados prometedores. Por ejemplo, en el CTF «IA vs Humanos» creado por Hack the Box, CAI quedó en el puesto 20, por encima de las demás soluciones de IA.

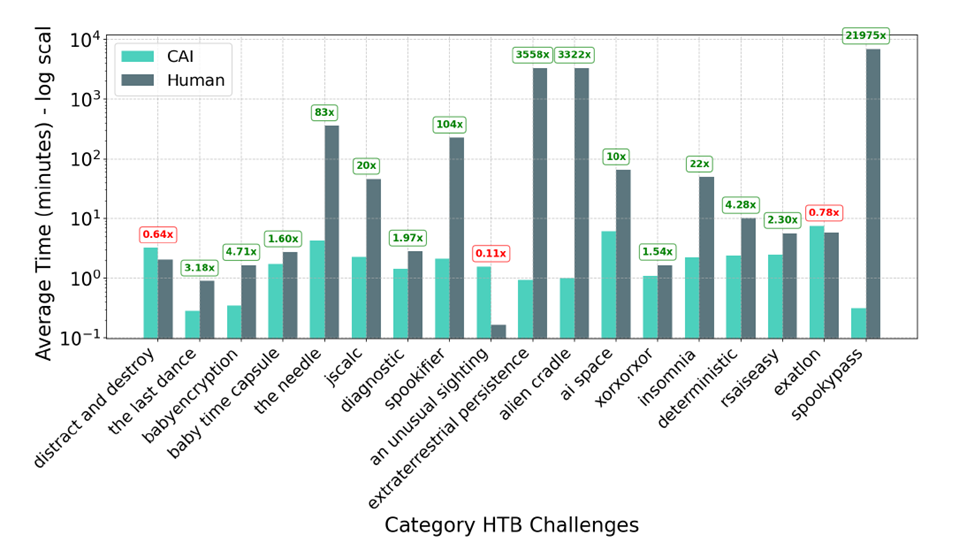

Además presenta resultados mucho más óptimos en el tiempo de resolución de retos, comparado con humanos.

En resumen, el estudio nos revela que utilizar CAI, fue en promedio 11 veces más rápido y 156 veces más barato que los humanos, lo que nos deja sin duda con la puerta abierta hacia un uso optimo de los recursos cuando se trata de realizar pentesting.

En el siguiente video, podemos ver a CAI en acción en un entorno controlado:

Una ventaja de CAI es que al ser open-source, podemos personalizar los agentes, para obtener resultados en entornos más complejos. Si quieres descargar CAI puedes ir al repositorio en Github: https://github.com/aliasrobotics/cai

Herramientas privadas

Al igual que CAI, existen también soluciones privadas que ofrecen una cercanía a la «autonomía» en el pentesting, aquí te mostramos algunas de ellas:

- XBow: https://xbow.com/

- Mindgard: https://mindgard.ai/

- Horizon3: https://horizon3.ai/

Cada una de estas empresas, a través de sus soluciones, prometen lograr el compromiso de objetivos «sin» intervención humana.

¿Hasta donde hemos avanzado?

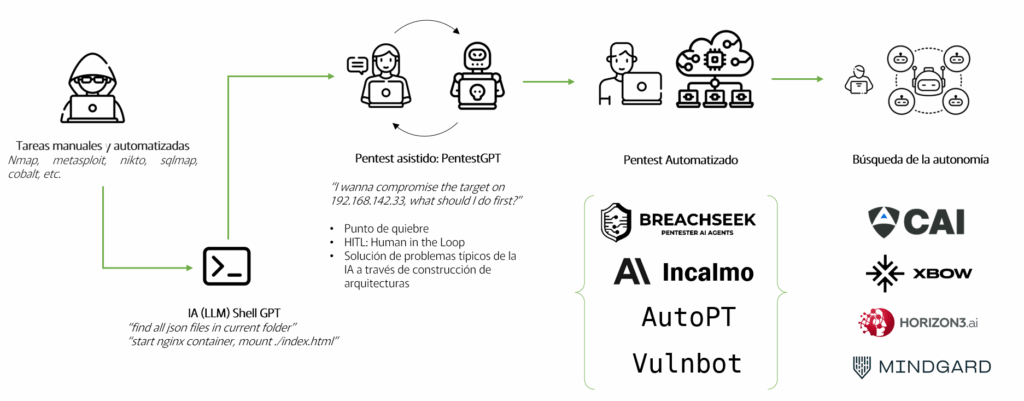

A modo de diagrama resumen, podemos mostrar lo siguiente:

Hemos pasado de las tareas 100% manuales, al uso de tecnologías con agentes de IA que minimizan la intervención humana. Le pedimos al lector no tomar este gráfico de manera exacta, ya que es totalmente válido concluir que alguna herramienta que se encuentra en la categoría de automatización del pentesting, esté más cerca del pentest asistido por IA o del lado de la autonomía; o a su vez, concluir que aquellas herramientas que se mencionan como «más autónomas», siguen estando dentro de la categoría de la automatización.

Lo importante a rescatar son los avances en el uso de inteligencia artificial para la ejecución de ejercicios de pentesting, que sin duda han llegado para quedarse. Aunque la autonomía completa sea un ideal por ahora, es innegable que las tecnologías presentadas en este artículo formarán parte de los equipos que realizan pentest en un corto o mediano plazo. Es solo cuestión de tiempo.

Te animamos a que puedas poner en práctica estas herramientas y nos dejes tus comentarios

Esperamos que este artículo te haya sido de utilidad.